Visual Attention Detection – Erkennung der visuellen Aufmerksamkeit per Eye Tracking und Computer Vision

Die Erfassung und Verarbeitung visueller Szenen ist für Menschen essenziell, um situationsgerechte Entscheidungen zu treffen. Der Mensch beobachtet auch das Blickverhalten anderer, um eine effiziente Zusammenarbeit zu ermöglichen.

Unser Ziel ist es, intelligente multimodale Schnittstellen, einschließlich kollaborativer Roboter, in die Lage zu versetzen, aufmerksamkeitsbewusst wie Menschen zu handeln.

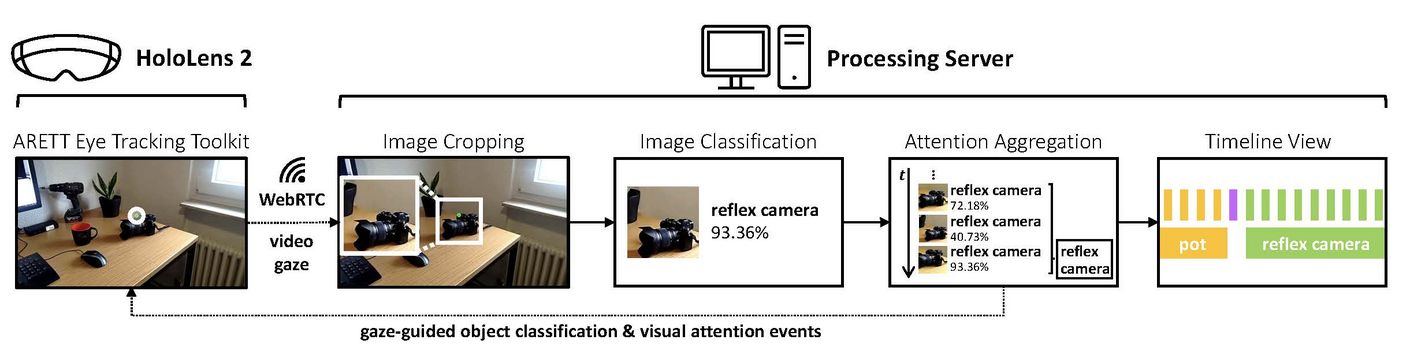

Das Team aus dem Forschungsbereich Interaktives Maschinelles Lernen hat mehrere Methoden entwickelt und evaluiert, die erkennen sollen, welche Objekte in einer Szene von einem Benutzer mittels kopfgetragener Eyetracker betrachtet wurden.

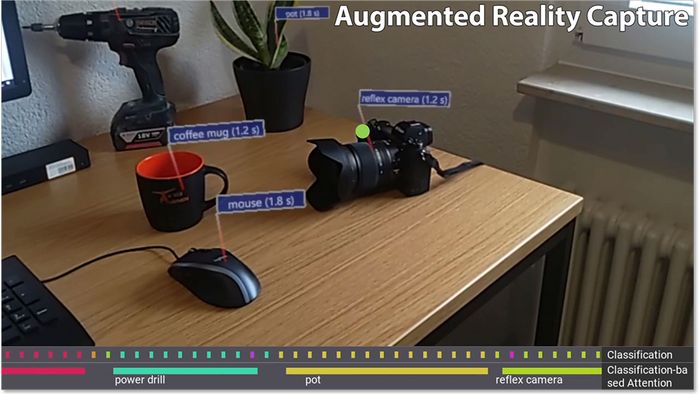

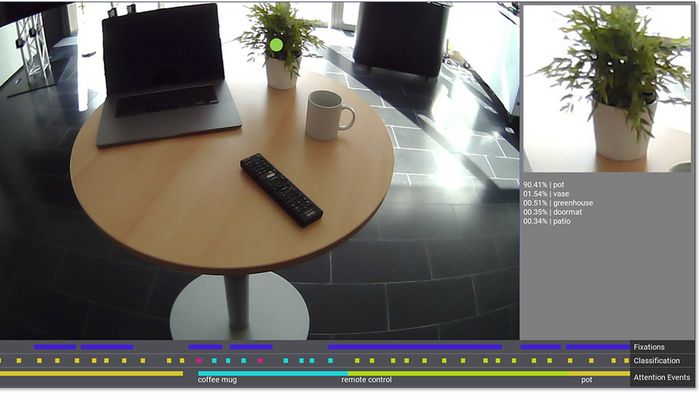

Dazu gehören Methoden zur Erkennung von Objekten in einer Szene und zur Zuordnung des menschlichen Blicks zu diesen Objekten in Echtzeit, Mixed-Reality-Anwendungen, die diese Informationen nutzen, sowie interaktive Komponenten für maschinelles Lernen, die eine schnelle Anpassung der zugrunde liegenden Modelle an neue Anwendungen ermöglichen.

In dem vom Bundesministerium für Bildung und Forschung (BMBF) geförderten Forschungsprojekt GeAR wurde die Software bereits eingesetzt, um kopfgetragene Eye-Tracking-Aufnahmen aus psychologischen Studien effizienter zu annotieren. Die gleichen Technologien werden nun in den laufenden Forschungsprojekten MASTER (EU) und NoIDLE (BMBF) eingesetzt und erweitert.

Das Projektteam entwickelt und evaluiert multimodale Schnittstellen, die die visuelle Aufmerksamkeit des Menschen als Kontextinformation in der Mixed Reality Mensch-Roboter-Interaktion und für interaktive Deep-Learning-Systeme nutzen.

DFKI.AI Day

Kontakt

Michael Barz

Forschungsbereich Interaktives Maschinelles Lernen

michael.barz@dfki.de