Das ACTIVE-Projekt entwickelt eine integrierte Multi-Roboter Plattform für die Neurochirugie. Eine leichte, bewegliche Roboterzelle und eine erweiterte Recheneinheit für vor- und intraoperative Kontrolle werden sowohl autonom wie auch kooperativ zusammen mit dem OP-Personal betrieben. Das Projekt soll den Stand der Forschung im Bereich der adaptiven Robotersteuerung vorantreiben. Dabei soll vor allem die Qualität und Zuverlässigkeit von chirurgischen Robotern verbessert werden.

Projektdetails

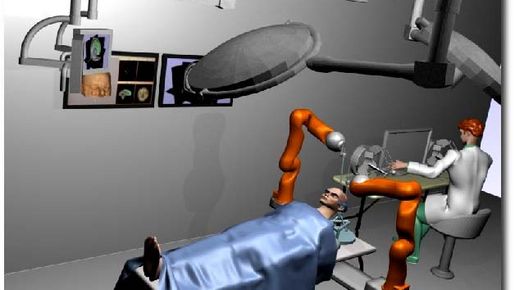

Im Projekt ACTIVE wird eine integrierte Multi-Roboterplattform für die Anwendung in der Neurochirurgie konzipiert und entwickelt. Im Zentrum steht dabei eine leichte und bewegliche Roboterzelle mit 20 Freiheitsgraden (DoFs), die mit Hilfe einer intelligenten Steuerung autonom und/oder in Kooperation mit dem OP-Personal in einer unstrukturierten Umgebung (Operationssaal) komplexe Prozesse (Operationen am offenen Gehirn) durchführen können soll.

Da die Patienten nicht fest auf dem OP-Tisch oder am Roboter fixiert werden können, muss das System, um diese dynamische Situation zu meistern, im Bereich der adaptiven Roboter-Kontrolle deutlich über den derzeitigen Stand der Technik und Forschung hinausgehen.

Als Ergebnis des ACTIVE-Projektes wird ein Robotersystem für die Behandlung von wachen (nicht narkotisierten) Patienten in der ambulanten Chirurgie anvisiert. Messungen und chirurgische Eingriffe sollen dabei von mehreren, kooperierenden Manipulatoren durchgeführt werden.

Eine neuartige haptische Schnittstelle für Telemanipulation und eine kooperative Steuerung ist auf die Bedürfnisse der menschlichen Operateure zugeschnitten und erlauben eine einfache Bedienung des Systems.

Die aktive und situationsabhängige Beschränkung der Aktionsoptionen des Systems wird in Echtzeit an die jeweiligen Umstände angepasst. So sollen ungewollte Schädigungen eloquenter (gesunder) Bereiche des Gehirns, z.B. während eines spontanen Epilepsieanfalls des Patienten, verhindert werden.

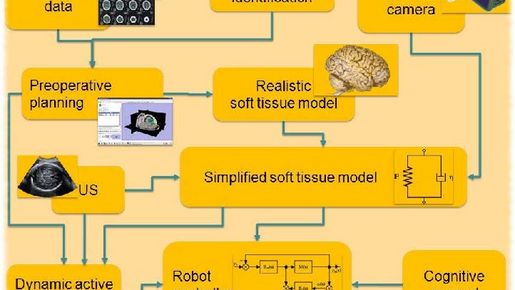

Der Operationsraum, als Inbegriff einer dynamischen und unstrukturierten Umgebung, stellt hohe Anforderungen an ein Robotersystem. Durch eine intensive Sensorüberwachung und den Einsatz lernender Methoden für die Analyse und Bewertung des Raumes und der darin agierenden Maschinen und Menschen (einschließlich des Patienten), soll der sichere Einsatz des Operationssystems unterstützt werden. Darauf basierend werden z.B. Entscheidungen über den aktuellen Sicherheitszustand des Gesamtsystems gefällt und in mehr oder weniger strikte Beschränkungen der Handlungs- und Bewegungsfreiheit der Roboter überführt. Zu diesem Zweck wurde im Projekt ein neuartiges Sensorik-Konzept entwickelt. Das DFKI hat hier Methoden entworfen und analysiert, die Informationen über den aktuellen Zustand des Gesamtsystems liefern. Methoden der kognitiven Datenanalyse werden eingesetzt, um im Vorfeld einer Operation den Zielort der geplanten operativen Maßnahmen im Gehirn genauer bestimmen zu können. Das DFKI hat sich im Laufe des Projektes in diesem Zusammenhang mit der Auswertung von klinischen Daten und EEG-Daten beschäftigt, die zur Lokalisierung von epileptischen Regionen im Gehirn verwendet werden können. Hierbei lag der Fokus auf der Entwicklung von automatischen Systemen, die den Neurologen bei seiner Arbeit unterstützen und die zeitaufwändige Analyse der Daten erleichtern.

Insgesamt soll ACTIVE die Qualität und Präzision der Arbeit chirurgischer Roboter erhöhen. Im speziellen Fall der Gehirnchirurgie soll der Chirurg in die Lage versetzt werden, Gehirnoperationen (vor allem bei Epilepsiepatienten, aber auch bei DBS und Tumorentfernungen) an wachen Patienten besser und sicherer durchführen zu können.

Zur Entwicklung und Auswertung der Methoden, die zur Analyse der EEG- und Sensordaten aus dem OP-Kontext verwendet wurden, wurde das am DFKI entwickelte Framework für maschinelles Lernen und Signalverarbeitung pySPACE verwendet. Mittels pySPACE konnten hier verschiedene Verfahren entwickelt, getestet und gegeneinander verglichen werden.

Partner

- POLIMI (IT) (Koordinator)

- CNR-ITIA (IT)

- IMPERIAL (UK)

- KIT (DE)

- IIT (IT)

- TECHNION (IL)

- TUM (DE)

- DFKI (DE)

- DDEP (IT)

- TASMC (IL)

- Force Dimension (CH)

- Renishaw (IRE)

- Medimaton (UK)

- CFc (IT)

- KUKA (DE)