Innerhalb des DAKARA-Projekts wird eine ultrakompakte, energieeffiziente und rekonfigurierbare Kameramatrix entwickelt. Neben Standard-Farbbildern stellt sie in Echtzeit präzise Tiefeninformationen bereit und bietet so die Grundlage für verschiedene Applikationen in der Automobilindustrie, der Produktion und vielen mehr. Die ultrakompakte Kameramatrix wird aus 4x4 Einzelkameras auf einem Wafer zusammengesetzt und mit einer Wafer-Level-Optik versehen, wodurch eine extrem kompakte Bauform von ca. 10 x 10 x 3 mm erreicht wird. Möglich wird dies durch die innovative Kameratechnologie der ams Sensors Germany GmbH. Der Aufbau als Kameramatrix erfasst die Szene aus sechzehn leicht versetzten Perspektiven und ermöglicht es so die Szenengeometrie (ein Tiefenbild) aus diesen mittels des Lichtfeldprinzips zu berechnen. Da solche Berechnungen sehr rechenintensiv sind, ist eine enge Integration der Kameramatrix mit einem effizienten, eingebetteten Prozessor erforderlich um Echtzeitanwendungen zu ermöglichen. Die Tiefenbildberechnungen, die vom Partner DFKI (Forschungsbereich Augmented Vision) erforscht und entwickelt werden, können so ressourcenschonend und in Echtzeit in der elektronischen Funktionsebene des Kamerasystems durchgeführt werden. Weiterhin können auf dem eingebetteten Chip verschiedene Applikationen zur Weiterverarbeitung der generierten Bilddaten in einem Anwendungsszenario laufen. Mögliche Applikationen profitieren maßgeblich davon, dass ihnen neben der Farbinformation auch die Tiefeninformation ohne weitere an-wendungsseitige Berechnungen zur Verfügung gestellt wird. Durch die ultrakompakte Bauweise ist es möglich die neue Kamera in sehr kleine und/oder filigrane Bauteile zu integrieren und dort als berührungslosen Sensor zu nutzen. Der Aufbau der Kamera-matrix ist rekonfigurierbar, sodass in Abhängigkeit der Anwendung auch ein spezielleres Layout verwendet werden kann. Außerdem kann auch die Tiefenbildberechnung rekonfiguriert werden und so auf bestimmte Anforderungen an die Tiefeninformation eingehen.

Die Innovation des DAKARA-Projekts stellt das ultrakompakte, energieeffiziente und rekonfigurierbare Gesamtsystem dar, das sowohl Farb- als auch Tiefenbilder bereit-stellt. Vergleichbare Systeme, die sich auch im Produktiveinsatz wiederfinden, sind in der Regel aktive Systeme, die Licht aussenden und so die Tiefe berechnen. Große Nachteile solcher Systeme sind der hohe Energieverbrauch, die große Bauform und die hohen Kosten. Passive Systeme haben einen wesentlich geringeren Energieverbrauch, sind aber noch im Forschungsstadium und weisen in der Regel große Bauformen und geringe Bildraten auf. DAKARA bietet erstmals eine passive Kamera, die mit einer ultrakompakten Bauform, hohen Bildraten, rekonfigurierbaren Eigenschaften und geringem Energieverbauch überzeugt, dabei das Forschungsstadium verlässt und in den Produktiveinsatz bei namhaften Anwendern aus unterschiedlichen Domänen geht.

Um die Mächtigkeit und Innovationskraft des DAKARA-Konzepts zu demonstrieren wird die neue Kamera im Projekt in zwei verschiedenen Anwendungsszenarien eingesetzt. Diese umfassen eine Intelligente Rückfahrkamera im Automobilbereich und die Werkerassistenz bei der manuellen Produktion. Die geplante Intelligente Rückfahrkamera des Partners ADASENS Automotive GmbH ist verglichen mit aktuell eingesetzten Systemen, die aus Ultraschallsensoren und einer Mono-Farbkamera bestehen, in der Lage das rückwärtige Fahrzeugumfeld räumlich, metrisch und semantisch zu interpretieren. Dadurch können bei automatisierten Parkvorgängen auch feinere Strukturen wie Bordsteinkanten oder Pfosten erkannt und berücksichtigt werden. Außerdem ist das System in der Lage Menschen semantisch zu erkennen und im Notfall Warnsignale auszulösen. Die DAKARA-Kamera liefert hier einen wesentlichen

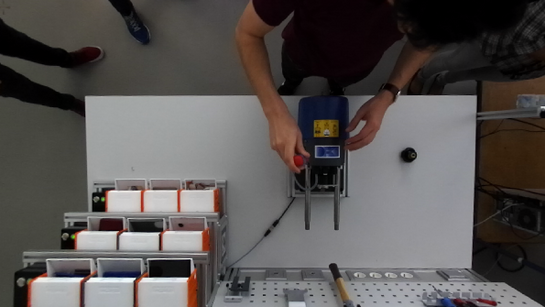

Beitrag zur Steigerung der Sicherheit beim automatisierten oder teilautomatisierten Fahren. Bei der Werkerassistenz wird ein manueller Montageprozess bei den Partnern Bosch Rexroth AG und DFKI (Forschungsbereich Innovative Fabriksysteme) abgebildet. Ziel ist es den Werker bei seinen Aufgaben zu unterstützen und abzusichern. Dazu wird die neue Kameramatrix über dem Handarbeitsplatz befestigt und sowohl Objekte als auch Hände durch die Algorithmen des Partners CanControls GmbH räumlich und zeitlich erfasst. Eine besondere Herausforderung dabei ist, dass Objekte wie Werkzeuge oder Werkstücke, die in der Hand gehalten werden nur sehr schwer von diesen trennbar sind. Möglich wird diese Trennung durch die zusätzliche Bereitstellung von Tiefeninformationen durch die DAKARA-Kamera. So werden in dem Szenario eine Greifweg-Analyse, eine Entnahme- und Füllstandskontrolle, die Interaktion mit einem Dialogsystem sowie die Werkzeug-Positionserfassung realisiert. Die Kamera soll eine Vielzahl an Sensoren, die momentan in verschiedenen manuellen Produktionsanlagen des Projektpartners Bosch Rexroth eingesetzt wird, ersetzen und so ein neues Qualitäts- und Kostenlevel erreichen.

In den nächsten drei Jahren soll die neue Kameramatrix entworfen, entwickelt und in den erwähnten Szenarien ausgiebig getestet werden. Ein erster Prototyp soll bis Spätsommer 2018 realisiert werden. Das Projekt „DAKARA“ wird vom Bundesministerium für Bildung und Forschung (BMBF) im Rahmen des Programms „Photonik Forschung Deutschland - Digitale Optik” gefördert. Das Projektvolumen beträgt insgesamt 3,8 Millionen Euro; davon wird fast die Hälfte durch die beteiligten Industriepartner aufgebracht.

Partner

- AMS Sensors Germany GmbH, Nürnberg (Konsortialführung)

- Deutsches Forschungszentrum für Künstliche Intelligenz GmbH (DFKI), Kaiserslautern (Technische Konsortialführung)

- ADASENS Automotive GmbH, Lindau

- Bosch Rexroth AG, Stuttgart

- CanControls, Aachen