MIT MARLON NUSKE SPRACH ELIANE EISENRING VON TRIVADIS.

Herr Nuske, derzeit befinden sich rund 28'210 Schrottteile in den Erdumlaufbahnen – alle gross genug, um einen aktiven Satelliten zu beschädigen oder sogar zu zerstören. Ist das so bedrohlich wie es klingt?

Auf den ersten Blick könnte man tatsächlich denken: Wir haben zigtausend Satelliten im Weltall, was ist das Problem, wenn da mal einer kaputt geht? Was die Lage aber erheblich verschärft, ist die Kettenreaktion, die Expertinnen und Experten befürchten. Bei einer Kollision mit Weltraumschrott würde nämlich nicht nur ein einzelner Satellit zerstört. Die Trümmerteile, die bei dem Zusammenstoss von diesem Satelliten wegflögen, könnten weitere Satelliten beschädigen, von denen wiederum Trümmerteile abfallen würden. Dadurch bestünde die Gefahr, dass ein ganzer Bereich im Weltraum im Wesentlichen unbefliegbar würde.

Wie kann künstliche Intelligenz (KI) da helfen?

Zunächst kann KI uns helfen, vorherzusagen, wann und wo die Gefahr einer Kollision besteht. Das wäre der erste Schritt der Kollisionsverhinderung: Mithilfe der Daten bezüglich Positionen und Geschwindigkeiten der Satelliten bestimmt man deren Laufbahn. Basierend darauf berechnet ein konventionell programmierterd Algorithmus potentielle Kollisionspunkte. An der Stelle setzen wir an: Mit Hilfe einer KI-Analyse der Datenbank aller möglichen Kollisionspunkte wollen wir das Risiko einer Kollision besser einschätzen. Denn nur die Kollisionen mit hohem Risiko werden anschliessend von Experten begutachtet. Eine bessere automatisierte Einschätzung kann also helfen, die Anzahl der Kollisionen zu reduzieren, die manuell begutachtet wird und gleichzeitig verhindern, dass Kollisionen mit hohem Risiko übersehen werden.

„Bei einer Kollision mit Weltraumschrott bestünde die Gefahr, dass ein ganzer Bereich im Weltraum im Wesentlichen unbefliegbar würde.”

Das wäre Schritt 1 bei der Kollisionsverhinderung – wie könnte man KI auch bei den weiteren Schritten einsetzen?

Wie gesagt, schauen sich im nächsten Schritt Menschen manuell die Kollisionen mit hohem Risiko an. Dann berechnen sie verschiedene Pfade, ermitteln, was für ein Ausweichmanöver man fliegen könnte und leiten dieses gegebenenfalls in die Wege. Auch hier könnte eine KI helfen, etwa indem sie auf Satelliten selbst automatisierte Ausweichmanöver festlegt. Da befinden wir uns dann aber auf einem anderen Level von Sicherheit als nur bei einer ersten Voreinschätzung des Risikos.

Höhere Sicherheitsanforderungen machen die Automatisierung von Prozessen und den Einsatz von KI ja immer heikler ...

So ist es, deshalb muss man dieses Thema stets im Hinterkopf behalten: Je höher das Risiko, das man eingeht, desto genauer muss man natürlich auch hinschauen und die Arbeitsweise der KI verstehen – Stichwort Explainable AI. Für einige Anwendungen kann man meiner Meinung nach problemlos KI verwenden und muss sich auch keine allzu grossen Sorgen machen, wenn etwas schief geht. Für andere Aufgaben lohnt es sich, zu überlegen, ob KI überhaupt die beste Lösung ist, oder ob sich konventionelle Algorithmen besser eignen. Hier können auch hybride Algorithmen helfen. Also solche, bei denen man einen konventionellen Algorithmus mit einem KI-Algorithmus kombiniert. So kann man zum Beispiel nur die Teile des konventionellen Algorithmus ersetzen, anstelle derer KI wirklich einen Vorteil bietet.

„Gerade, wenn man KI direkt in einem Satelliten einsetzen möchte, macht es einen grossen Unterschied, ob man die neuste GPU-Graphikkarte benutzen kann oder mit Instrumenten arbeiten muss, die eher dem Standard von vor fünf Jahren entsprechen.”

Was unterscheidet eigentlich die Anwendung von KI im Weltraum von der auf der Erde?

Eine Herausforderung, die man generell in der Raumfahrt hat, ist, dass man dem aktuellen Stand der Technik oft um mehrere Jahre hinterherhinkt. Es dauert an sich schon unheimlich lange, ein Instrument ins Stadium zu bringen, in dem man es ins Weltall schicken kann. Dann kommen noch diverse Sicherheitsvorschriften hinzu. Und gerade, wenn man mit Methoden wie KI arbeitet und diese direkt in einem Satelliten oder in einem Roboter einsetzen möchte, macht es einen grossen Unterschied, ob man die neuste GPU-Graphikkarte benutzen kann oder mit Instrumenten arbeiten muss, die eher dem Standard von vor fünf Jahren entsprechen.

Wechseln wir den Fokus von Satelliten auf Satellitenbilder der Erde. Wie werden diese derzeit analysiert und wie könnte KI dieses Verfahren verbessern?

Daran arbeiten wir im Rahmen der AI4EO (Artificial Intelligence For Earth Observation) Solution Factory der ESA und des DFKI. Wir schauen uns an, was wir mit den Daten, die Satelliten uns liefern, machen können. Da gibt es natürlich eine riesige Bandbreite an Anwendungsbereichen: Man kann überflutete Gebiete identifizieren, Waldbrände früh vorhersagen oder die Entwicklung von Grünflächen in Städten analysieren. Auf diesem Gebiet besteht derzeit ein riesiger Zuwachs, denn seit 2017 haben wir mit Sentinel-2A und Sentinel-2B zwei Satelliten in der Umlaufbahn, durch die wir alle fünf Tage ein Bild von jedem Ort auf der Erde bekommen, das frei zur Verfügung gestellt wird. Gerade bei einer derartigen Datenmenge ist es natürlich ein riesiger Vorteil, mithilfe von KI eine automatisierte Bildanalyse machen zu können.

„Wenn man Satellitenbilder analysiert, kann man überflutete Gebiete identifizieren, Waldbrände früh vorhersagen oder die Entwicklung von Grünflächen in Städten analysieren.”

An welcher konkreten Anwendung arbeiten Sie im Zusammenhang mit Satellitenbildern gerade?

Wir sind aktuell in einen Use Case involviert, bei dem es darum geht, Vorhersagen für Erträge in der Landwirtschaft zu treffen. Da greift man einerseits auf Satellitenbilder von den entsprechenden Feldern zurück, andererseits auch auf Datenquellen, die Informationen zu Bodenqualität oder Wetter liefern. Um den Ertrag am Ende der Saison abschätzen zu können, muss man diese verschiedenen Daten miteinander kombinieren.

Auf einem operativen Level bestimmt nicht ganz einfach.

Das stimmt. Die Datenformate unterscheiden sich stark in Sachen räumliche und zeitliche Auflösung. Satellitenbilder bekommt man, wie gesagt, etwa alle fünf Tage, mit einer Auflösung von 10 Metern pro Pixel. Bei digitalen Höhenmodellen beträgt die räumliche Auflösung 30 Meter pro Pixel, man bekommt insgesamt aber nur ein Bild, also nur einen einzigen Datenpunkt – die Höhe eines Gebiets ändert sich ja kaum über die Zeit hinweg. Bei Wetterdaten wiederum hat man kaum räumliche Auflösung – man bestimmt nicht das Wetter für jeden einzelnen Quadratmeter auf dem Feld – dafür eine sehr hohe zeitliche Auflösung. Und für jeden einzelnen Datensatz muss man sich überlegen: Trainiere ich zwei unterschiedliche Machine Learning-Modelle und fusioniere sie am Ende, oder möchte ich die Daten vorher schon zusammen- und in das gleiche Modell reinbringen?

Nebst der Analyse von Satellitenbildern und der Kollisionsverhinderung arbeiten Sie auch daran mit, wie man KI-Methoden zum Erstellen eines «digitalen Zwillings» der Erde nutzen kann. Was hat es damit auf sich?

Das ist ein Projekt, das im sogenannten «European Green Deal» und dem darauf basierenden «Destination Earth»-Projekt angesiedelt ist. Dabei geht es darum, ein digitales Modell der ganzen Erde zu entwickeln. Die ersten Anwendungsgebiete, die vorhergesehen sind, sind dementsprechend stark auf den Klimaschutzsicht ausgerichtet. Mit einem möglichst akkuraten digitalen Abbild der Erde kann man zum einen Voraussagen für die Zukunft treffen, wie wir es teilweise jetzt schon mithilfe von Klimamodellen tun. Man versucht also Fragen zu beantworten, wie: Wie entwickelt sich das Klima weiter? Wie würde es sich entwickeln, wenn wir schlagartig in der Lage wären, keine Treibhausgase mehr auszustossen? Oder wenn wir einfach so weitermachten wie bisher? Was wir uns konkret am DFKI anschauen, ist, wo beim Treffen dieser Vorhersagen KI eine Rolle spielen kann und welche Teile von Modellen man mit Machine Learning ersetzen sollte.

„Solche Vorhersagen und Antworten auf «Was wäre wenn»-Szenarien würden politischen Entscheidungsträgern helfen, die Folgen ihrer Handlungen abzuschätzen.”

Digitale Zwillinge – gibt es die nicht auch in der Industrie?

Doch, da ist es sogar sehr verbreitet, dass man ein digitales Modell eines Produktionsprozesses erstellt, um diesen zu simulieren und gegebenenfalls zu verbessern. Und das Gleiche kann ich natürlich übertragen auf die gesamte Erde, da ist es nur entsprechend herausfordernder die unterschiedlichen Daten ins gleiche Format zu bringen. Gerade für ein Modell der Erde gibt es in der Forschung schon unglaublich viele Modelle aus unterschiedlichen Bereichen, aber häufig existieren sie getrennt voneinander.

Die Herausforderung ist es also, ein Modell, das ich für die Atmosphäre habe, mit einem Modell, das ich für die Ozeane habe, zu koppeln. Dann könnte man auch viel spezifischere Dinge berechnen. Zum Beispiel: Wie entwickelt sich die Luftqualität in Deutschland, wenn wir im Land mehr Bäume pflanzen? Und welche Auswirkungen hat das insgesamt für unser Klima? Solche Vorhersagen und Antworten auf «Was wäre wenn»-Szenarien würden politischen Entscheidungsträgerinnen und Entscheidungsträgern helfen, die Folgen ihrer Handlungen abzuschätzen.

DIGITALE ZWILLINGE IM BUSINESS

Ein digitaler Zwilling ist das virtuelle Abbild eines Produkts oder Prozesses, das mit realen Daten gefüttert wird. Die realistische Modellierung kann Unternehmen dabei helfen, Produkte oder Prozesse zu überwachen und zu verbessern. In der Automobilentwicklung zum Beispiel testen Ingenieure Belastungsszenarien für einzelne Komponenten oder ganze Fahrzeuge bis hin zum virtuellen Crashtest. Der italienische Sportwagenbauer Maserati hat so die Entwicklungszeit seiner Fahrzeuge fast halbiert. Durch die Vernetzung mit Machine Learning könnte ein digitaler Zwilling seinem physischen Gegenstück sogar automatisiert Rückmeldung geben – sodass beide zusammen letztlich zu einem selbststeuernden System werden.

Im ESA_Lab@DFKI arbeiten Forscherinnen und Forscher direkt mit Mitarbeitenden aus der Industrie zusammen. Was sind die Vorteile dieser Zusammenarbeit?

In den sogenannten «TransferLabs» des DFKI können unsere Expertinnen und Experten für KI mit den Fachpersonen für das jeweilige Anwendungsgebiet direkt an einer Lösung für ein bestimmtes Projekt arbeiten. Für uns ist der direkte Austausch auch wichtig, damit wir nicht daran vorbeientwickeln, was in der Industrie eigentlich benötigt wird. Im Gegenzug profitieren die Unternehmen von unserer Nähe zur Grundlagenforschung, die immer wieder wichtige Erkenntnisse liefert, um Projekte entscheidend weiterzubringen.

Haben Sie dafür ein Beispiel?

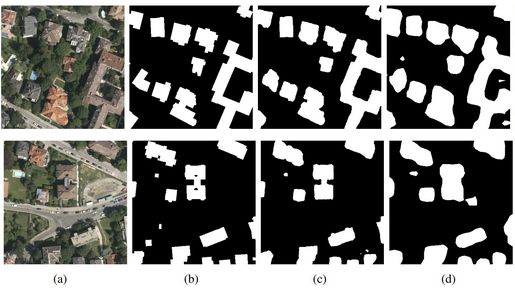

Es gibt ein aktuelles Projekt, bei dem es darum geht, basierend auf Satellitenbildern und mithilfe eines Algorithmus die Grundrisse von Gebäuden zu erkennen. Bis anhin wurde das Problem formuliert als: «Liegt ein Pixel in einem Gebäude drin oder nicht?» Auf dieser Grundlage hat man einem neuronalen Netzwerk, einem FCN (Fully Convolutional Network), Satellitenbilder gegeben und dieses einschätzen lassen, ob es sich um ein Gebäude handelt oder nicht (siehe Abbildung 1, (d)).

Nun hat aber die Grundlagenforschung herausgefunden, dass die Erkennung deutlich besser funktioniert, wenn man statt dieser Aufgabenstellung die Frage stellt: «Was ist die Distanz eines Pixels zum Umriss des Gebäudes?» So kann man jedem Pixel eine Zahl geben, die den Abstand zum Aussenrand des Gebäudes darstellt. Damit gebe ich dem sogenannten Multitasking-Netzwerk mehr Möglichkeiten zu unterscheiden und es kann mit höherer Treffsicherheit bestimmen, ob etwas ein Gebäude ist oder nicht – nur dadurch, dass man die Aufgabe anders gestellt hat (siehe Abbildung 1, (c)).

Zum Schluss noch die Frage aller Fragen: Wann findet die erste komplett KI-gesteuerte Weltraum-Mission statt?

Dazu könnten meine Kolleginnen und Kollegen, die im Bereich Robotik in der Raumfahrt arbeiten, viel mehr sagen (lacht). Im Bereich unbemannter autonomer Systemen und deren Einsatz in lebensfeindlichen Umgebungen, so auch im Weltall, ist das DFKI sehr aktiv. Kürzlich wurde zum Beispiel mit einem Unterwasser-Roboter Langstrecken-Navigation für die Erkundung von Eismeeren, wie auf dem Jupiter-Mond Europa, getestet.

Es ist auf jeden Fall eine sehr dynamische Entwicklung und ich bin schon gespannt darauf, was uns die künstliche Intelligenz in den nächsten zehn, zwanzig oder auch fünfzig Jahren an technologischen Neuerungen bringen wird.

ZUR PERSON

Dr. Marlon Nuske (*1992) ist seit 2021 Senior Researcher am Deutschen Forschungszentrum für Künstliche Intelligenz (DFKI) in Kaiserslautern. Unter anderem leitet er die AI4EO Solution Factory, die Machine Learning zur Analyse von Erdbeobachtungsdaten einsetzt, und forscht an der ML basierten Kollisionsvorhersage von Satelliten. Nuske hat einen Doktor in Physik von der Universität Hamburg.