Vertrauenswürdige KI: Die Brücke zwischen Innovation und Akzeptanz

| Finanzwirtschaft | Gesundheit & Medizin | Industrie 4.0 | Mobilität | Smart Home & Assisted Living | Wissen & Business Intelligence | IT Security | Lernende Systeme | Mensch Maschine Interaktion | Agenten und Simulierte Realität | Cyber-Physical Systems | Eingebettete Intelligenz | Smarte Daten & Wissensdienste | Smart Enterprise Engineering

Vertrauen als Grundlage für eine nachhaltige KI-Zukunft

Vertrauenswürdige Künstliche Intelligenz ist weit mehr als eine technologische Herausforderung – sie ist eine Grundvoraussetzung für die breite gesellschaftliche Akzeptanz und wirtschaftlichen Erfolg intelligenter Systeme. In Deutschland und Europa wächst die Erkenntnis, dass KI nicht nur leistungsfähig, sondern auch sicher, nachvollziehbar und ethisch vertretbar sein muss. Um diesen Anforderungen gerecht zu werden, stehen Unternehmen, öffentliche Institutionen und politische Entscheidungsträger vor der Aufgabe, verlässliche Standards und Prüfverfahren zu entwickeln, die sowohl diesen Anforderungen gerecht werden als auch zunehmende Innovationskraft gewährleisten.

Ein entscheidender Baustein für das Vertrauen in KI ist Transparenz. Nutzerinnen und Nutzer müssen nachvollziehen können, wie ein System zu seinen Entscheidungen gelangt – insbesondere in sicherheitskritischen oder ethisch sensiblen Bereichen wie der Medizin, der Finanzwelt oder der Robotik. Hier setzt die Forschung am DFKI einen Fokus: Durch interdisziplinäre Zusammenarbeit werden Prüfkriterien, Zertifizierungsverfahren und formale Garantien erarbeitet, die eine objektive Bewertung der Verlässlichkeit und Fairness von KI-Modellen ermöglichen. Initiativen wie MISSION KI, CERTAIN und HumanE-AI.net sowie die Projekte CRAI und VeryHuman zeigen, wie sich technologische Exzellenz und regulatorische Anforderungen in einem praxisnahen Rahmen verbinden lassen.

MISSION KI: Ein Framework für Zertifizierungen

Ein konkretes Beispiel für diesen Ansatz ist das Vorhaben MISSION KI. Die durch das Bundesministerium für Digitales und Verkehr zum Leben erweckte Initiative widmet sich der Herausforderung, die Entwicklung vertrauenswürdiger KI-Systemen zu stärken. Dies wird durch effiziente Prüfstandards für KI-Systeme mit niedrigem und hohem Risiko erreicht, welche abstrakte KI-Qualitätsdimensionen wie Transparenz und Nichtdiskriminierung in konkret messbare Größen und damit in klar definierte Prüfkriterien überführen.

„Besonders in kritischen Anwendungsfeldern – beispielsweise in der Diagnostik oder in autonomen Fahrzeugen – müssen KI-Modelle nachvollziehbare und überprüfbare Entscheidungen treffen. Hierbei entstehen Synergien zwischen Wissenschaft und Industrie, die gemeinsam an der Spezifikation von Prüfkriterien arbeiten und so eine Brücke zwischen technologischer Entwicklung und regulatorischer Praxis schlagen.“

Das DFKI trägt im Rahmen von MISSION KI zur Entwicklung und Feststellung der Vertrauenswürdigkeit insbesondere von Hochrisikosystemen bei. Dabei wird ein hybrider Ansatz verfolgt, um die abstrakten Anforderungen der KI-Qualität & Vertrauenswürdigkeit zu operationalisieren und sie mithilfe konkreter Methoden implementierbar und prüfbar zu machen. Das DFKI arbeitet dabei an:

- einer Qualitätsplattform, welche während der Entwicklung konkreter KI-Systeme durch Empfehlungen spezifischer Technologien zu Verbesserungen bezüglich ihrer Vertrauenswürdigkeit beitragen soll.

- einer Testplattform, welche Aspekte von Vertrauenswürdigkeit mittels technischer Prüfwerkzeuge messbar und feststellbar machen soll.

© DFKI, Lando Michael Lehmann

© DFKI, Lando Michael LehmannFünf konkrete Anwendungen aus dem Bereich der Medizin, welche durch das DFKI in Zusammenarbeit mit Anwendungspartnern entwickelt werden, werden schließlich zur Erprobung der entwickelten Methoden herangezogen. Darüber hinaus leistet das DFKI im Rahmen des mit MISSION KI gemeinsam betriebenen Innovations- und Qualitätszentrum (IQZ) Kaiserslautern einen wichtigen Beitrag zum Aufbau einer starken, regionalen KI-Community. Dabei steht der Kompetenzaufbau von Unternehmen und Gründern durch den Wissenstransfer aus der KI-Spitzenforschung im Fokus.

CERTAIN: Garantien als Weg zu mehr Vertrauen

Vertrauen in KI entsteht nicht allein durch Regulierung und Rahmenbedingungen, sondern durch nachweisbare Garantien. In diesem Kontext arbeitet das DFKI durch CERTAIN an einer europaweiten Initiative zur Validierung und Zertifizierung vertrauenswürdiger KI-Systeme.

“CERTAIN konzentriert sich darauf, Zertifizierung vertrauenswürdiger KI-Systeme zu entwickeln. Während das IQZ Unternehmen und die Industrie durch praxisnahe Qualitätsprüfungen, Beratungen und Kompetenzaufbau unterstützt, fokussiert sich CERTAIN auf die europaweite Vernetzung von Forschern, die Durchführung methodischer Grundlagenforschung sowie die Entwicklung ethischer Leitlinien für den verantwortungsvollen Einsatz von KI.“

Dies beinhaltet umfangreiche Tests unter verschiedenen Bedingungen, um Szenarien zu simulieren, die in der realen Welt auftreten könnten. CERTAIN verfolgt daher einen mehrdimensionalen Ansatz:

- Guarantees by Design: KI-Modelle werden von Anfang an mit Mechanismen ausgestattet, die ihre Verlässlichkeit sicherstellen.

- Guarantees by Tools: Testwerkzeuge ermöglichen die gezielte Überprüfung von KI-Systemen unter verschiedenen Bedingungen.

- Guarantees by Insight: Transparenz wird durch Visualisierungs- und Analysemethoden gefördert, die nachvollziehbar machen, wie ein System arbeitet.

- Guarantees by Interaction: Menschliches Feedback wird aktiv in den Lernprozess von KI integriert, um Systeme an gesellschaftliche Erwartungen anzupassen.

HumanE-AI.net: Menschzentrierte KI als Differenzierungsmerkmal

Während in anderen Teilen der Welt vor allem die wirtschaftliche Verwertbarkeit von KI im Fokus steht, verfolgt Europa einen dezidiert menschenzentrierten Ansatz. Dies zeigt sich auch in der Initiative HumanE-AI.net, die darauf abzielt, KI-Systeme als unterstützende, nicht ersetzende Technologie zu gestalten. KI soll als "kognitives Exoskelett" fungieren – nicht als autonomer Entscheider, sondern als intelligentes Assistenzsystem, das Menschen in komplexen Situationen unterstützt.

„Die kulturelle Akzeptanz von KI ist ein bemerkenswert wichtiger Aspekt. Studien zeigen, dass Vertrauen in Technologie stark von gesellschaftlichen Faktoren beeinflusst wird. In Europa sind Transparenz und ethische Grundsätze zentrale Anforderungen an KI-Systeme – und damit auch ein potenzieller Wettbewerbsvorteil.“

Projekte wie HumanE-AI.net untersuchen, wie sich diese Anforderungen in technische Standards überführen lassen, um Vertrauen systematisch zu stärken.

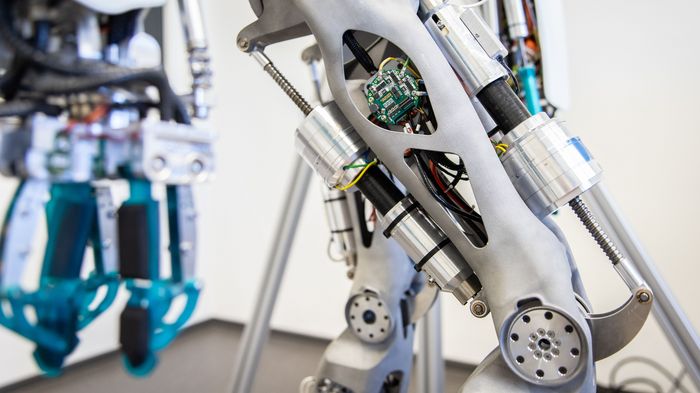

VeryHuman: Vertrauenswürdige Robotik durch formale Verifikation

Eine essenzielle Voraussetzung für vertrauenswürdige KI ist die Möglichkeit, belastbare Garantien für ihr Verhalten zu geben – insbesondere in der Robotik, wo autonome Systeme direkt mit Menschen interagieren. Das Forschungsprojekt VeryHuman verfolgt diesen Ansatz mit einem hybriden Verifikationsmodell, das mathematische Modellierung mit KI-Methoden kombiniert, um die Sicherheit und Nachvollziehbarkeit humanoider Roboter zu gewährleisten.

„Ein wesentliches Ziel von VeryHuman ist die mathematische Modellierung und Verifikation des Bewegungsverhaltens humanoider Roboter. Im Gegensatz zu stationären Maschinen oder klassischen Industrierobotern erfordert ihre Fortbewegung eine hochkomplexe Steuerung mit zahlreichen Freiheitsgraden und variierenden Umgebungsbedingungen.“

© DFKI, Anne-Marie Popp

© DFKI, Anne-Marie Popp © DFKI, Anne-Marie Popp

© DFKI, Anne-Marie PoppDas Kernproblem ist dabei die Gewinnung realer Trainingsdaten. Klassische KI-Modelle benötigen große Datenmengen, um zuverlässige Vorhersagen treffen zu können. Doch humanoide Roboter sind nicht in der Lage, Millionen von Bewegungsabläufen autonom zu durchlaufen – sei es aufgrund physischer Beschränkungen oder Sicherheitsrisiken. Daher kombiniert VeryHuman Simulationen mit formalen Methoden der Kontrolltheorie, um ein abstraktes Modell des Gehverhaltens zu erstellen. Durch diesen Ansatz lässt sich mathematisch beweisen, dass ein Roboter in jeder Situation ein sicheres und stabiles Verhalten zeigt.

Die Arbeit der DFKI-Forschenden liefert so die methodischen Grundlagen, um formale Garantien für das Verhalten von Robotern zu geben – eine zentrale Voraussetzung für ihre sichere Integration in industrielle und alltägliche Anwendungen. Durch die mathematische Modellierung und Abstraktion komplexer Bewegungsabläufe kann VeryHuman nachweisen, dass Roboter ihr Verhalten systematisch und vorhersehbar anpassen. Langfristig könnte dieser Ansatz den Weg für standardisierte Zertifizierungen humanoider Roboter ebnen – vergleichbar mit einem TÜV-Siegel für autonome Systeme. Damit leistet VeryHuman einen wichtigen Beitrag zur Schaffung vertrauenswürdiger KI, die nicht nur technologisch leistungsfähig, sondern auch überprüfbar, sicher und gesellschaftlich akzeptabel ist.

CRAI: Ein KI-Reallabor für den Mittelstand

Die Entwicklung vertrauenswürdiger KI stellt insbesondere kleine und mittlere Unternehmen (KMU) vor große Herausforderungen: Während regulatorische Vorgaben immer präziser werden, fehlt es vielen Betrieben an technischen und finanziellen Ressourcen, um diese Anforderungen zu erfüllen. Das Forschungsprojekt CRAI (KI-Reallabor für den Mittelstand) adressiert dieses Problem, indem es eine praxisnahe und wissenschaftlich fundierte Unterstützung für KMU bereitstellt. CRAI bringt Akteure aus Wissenschaft, Wirtschaft und Regulierung zusammen, um vertrauenswürdige KI-Systeme gemeinsam zu entwickeln, zu testen und für die Anwendung im Mittelstand zu optimieren.

„Das ‚regulatorische Lernen‘ ist ein Schlüsselprinzip von CRAI. In Zusammenarbeit mit Unternehmen, Wissenschaftlern und Regulierungsbehörden entwickeln wir im Reallabor praxisorientierte Leitlinien für den AI Act und Data Act – und übernehmen eine Vorreiterrolle in Europa bei der Gestaltung zukunftsfähiger Regulierungen für Künstliche Intelligenz.“

Dieser Ansatz stellt sicher, dass KMU frühzeitig mit regulatorischen Anforderungen vertraut gemacht werden und diese in ihre Entwicklungsprozesse integrieren können („Compliance by Design“). Gleichzeitig profitieren Regulierer von den Erkenntnissen aus der realen Anwendung, was eine iterative Anpassung der rechtlichen Rahmenbedingungen an technologische Entwicklungen ermöglicht.

In Zusammenarbeit mit mittelständischen Unternehmen entstehen Referenzlösungen und Prototypen, die eine Balance zwischen technischer Leistungsfähigkeit, regulatorischer Konformität und wirtschaftlicher Tragfähigkeit bieten. Die entwickelten Modelle werden auf ihre Transparenz, Erklärbarkeit und Fairness hin überprüft und können als Blaupause für ähnliche Anwendungen im Mittelstand dienen.

Durch seine starke Anwendungsorientierung ergänzt CRAI bestehende DFKI-Aktivitäten im Bereich der vertrauenswürdigen KI, indem es Unternehmen über den gesamten KI-Entwicklungszyklus hinweg begleitet. Neben wissenschaftlichen Publikationen und Best-Practice-Guidelines wird das Projekt den Aufbau einer Plattform vorantreiben, die Unternehmen Zugang zu Schulungsmaterialien, Evaluierungswerkzeugen und zertifizierten KI-Modellen bietet. So leistet CRAI einen entscheidenden Beitrag zur nachhaltigen Digitalisierung und Wettbewerbsfähigkeit des deutschen Mittelstands.

Vertrauenswürdige KI als europäisches Innovationsmodell

Vertrauenswürdige KI ist kein statischer Zustand, sondern ein kontinuierlicher Entwicklungsprozess, der wissenschaftliche Exzellenz mit gesellschaftlicher Verantwortung verknüpft. Um nachhaltige Akzeptanz zu fördern, bedarf es eines engen Dialogs zwischen Forschung, Wirtschaft, Politik und Gesellschaft. Die am DFKI entwickelten Methoden zur Zertifizierung, formalen Verifikation und regulatorischen Unterstützung bieten einen richtungsweisenden Beitrag für die sichere und ethisch vertretbare Nutzung von KI.

Europa hat die Möglichkeit, mit einem menschenzentrierten KI-Ansatz eine globale Vorreiterrolle einzunehmen. Dies erfordert jedoch eine konsequente Verbindung von technologischer Innovationskraft, regulatorischer Weitsicht und gesellschaftlicher Akzeptanz. Projekte wie MISSION KI, CERTAIN, HumanE-AI.net, CRAI und VeryHuman demonstrieren, dass die Zukunft der Künstlichen Intelligenz nicht nur durch Leistung, sondern auch durch Vertrauen und Verantwortung gestaltet wird.

Gemeinsam die Zukunft der vertrauenswürdigen KI gestalten

Die Entwicklung und Implementierung vertrauenswürdiger KI erfordert den Schulterschluss von Wissenschaft, Wirtschaft und Politik. Wir laden Unternehmen, öffentliche Institutionen und politische Entscheidungsträger ein, sich aktiv an der Gestaltung sicherer, transparenter und leistungsfähiger KI-Technologien zu beteiligen. Ob durch gemeinsame Forschungsprojekte, den Transfer wissenschaftlicher Erkenntnisse in die Praxis oder die Entwicklung neuer Prüf- und Zertifizierungsverfahren – lassen Sie uns gemeinsam daran arbeiten, Vertrauen als Leitprinzip der KI-Entwicklung zu verankern.

Interessierte Unternehmen, Forschungseinrichtungen und politische Akteure können sich für Kooperationen oder weiterführende Informationen an das DFKI wenden.